Oraz trochę o świadomości i inteligencji zwierząt i parę innych rzeczy w temacie, czasem z przymrużeniem oka.

1. Od siebie, nie zawsze mądrze

Nie jestem naukowcem, badaczem. Jestem praktykiem, ale zawsze interesowała mnie nauka, czytuję prace naukowe (głównie z fizyki, astronomii) w tym, te dotyczące AI. Fascynuje mnie tematyka świadomości i inteligencji tworów człowieka, i implikacji prawno-społecznych tegoż.

Tworzę rozwiązania wykorzystujące AI, ale też piszę SF, gdzie AI zajmuje ważne miejsce.

Na wstępie troszkę filozofii, zapraszam do eksperymentu myślowego.

Wyobraźmy sobie człowieka, możesz to być Ty.

Zapadasz na chorobę, która powoduje, iż nie możesz zdobywać nowej wiedzy. Działa tylko pamięć długotrwała, pamiętasz tylko to, czego się nauczyłeś do momentu zachorowania.

Zapadasz w śpiączkę, ale taką dziwną, gdy ktoś zada Ci pytanie, budzisz się, możesz odpowiedzieć mając całą pamięć, po czym od razu zasypiasz.

Gdy ta sama osoba, zada zaraz inne pytanie, obudzisz się, ale nie będziesz pamiętał, że przed chwilą na coś tej osobie odpowiadałeś, chyba, że dostaniesz pełna informację, o co osoba pytała, i co ty na to odpowiedziałeś.

Czy, gdyby Cię ktoś wcześniej nie znał (albo jeszcze lepiej kosmita, który zupełnie inaczej myśli niż my, ludzie), i przystąpiłby do badania, uznałby, że jesteś świadomą istotą? Trudno powiedzieć.

Tak, dziś działają modele LLM czyli popularnie AI.

Są ogromnym kosztem uczone, trenowane, po czym trafiają do nich treści i zwracane są odpowiedzi.

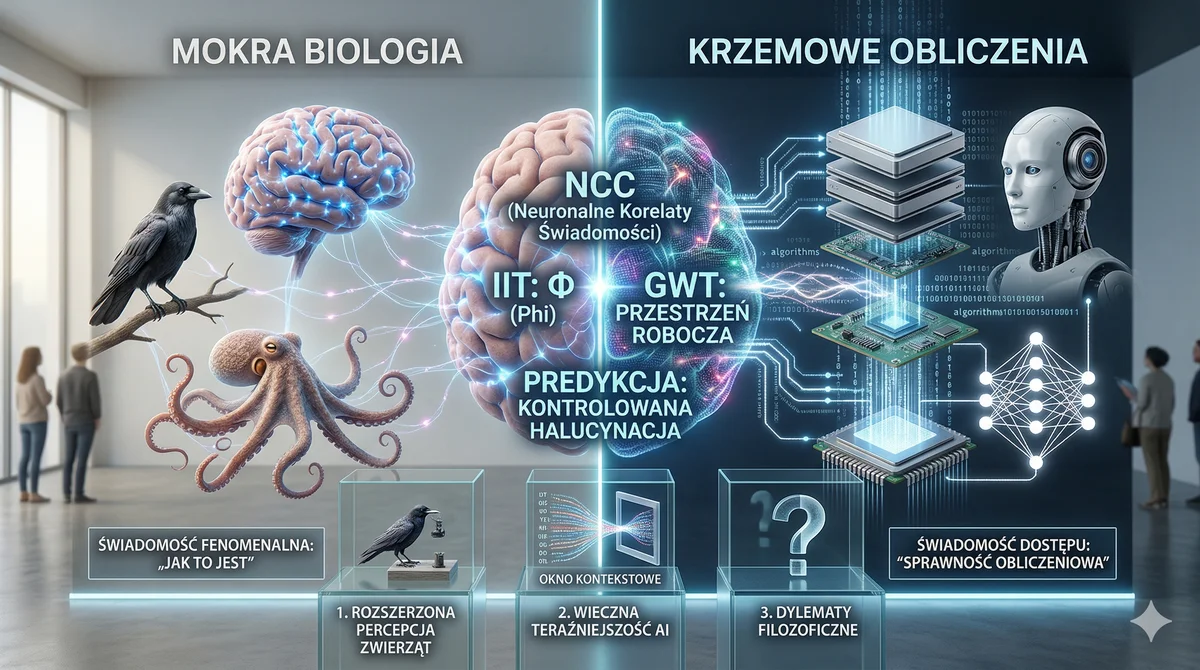

AI funkcjonują więc w stanie „wiecznej teraźniejszości”, ograniczonej sztywnymi ramami okna kontekstowego. Okno kontekstowe to bieżąca pamięć, to co może wprost trafić do modelu.

2. Czym jest świadomość według nauki?

No właśnie, problem w tym, że nauka nie ma jasnej definicji, to jedna z zagadek. Jedni uważają, że zwierzęta są świadome (np. ja) a inni, że nie, i że operują na instynktach.

Przez setki lat nauka (i niestety również filozofia) traktowała zwierzęta jak biologiczne maszyny. Kartezjusz twierdził (uważając, że duszę mają tylko ludzie), że pies, który skomle z bólu, to po prostu automat - reaguje na bodziec jak sprężyna na nacisk, wydaje dźwięki, ale w środku „nikogo nie ma”.

Dziś wiemy, że grubo się mylił choć nie w kontekście duszy oczywiście, tu tematu nie tykam😉.

Jeśli jesteś w tej grupie, która intuicyjnie uważa, że zwierzęta są świadome (tak jak ja), to jest to zgodne z aktualnym konsensusem naukowym. Przełom nastąpił w 2012 roku, kiedy wybitni neurobiolodzy podpisali słynną Deklarację z Cambridge. Oficjalnie przyznali w niej, że ssaki i ptaki posiadają neurologiczne podłoże świadomości i stany emocjonalne.

Eksperymenty z Wronami i Ośmiornicami wykazały jednoznacznie, że zwierzęta te, mają wewnętrzne przemyślenia, wewnętrzny głos. Tam, gdzie nauka potrzebuje badań, eksperymentów i potwierdzeń właściciel zwierząt (jak ja) wie to na podstawie własnych doświadczeń. Spryt zwierząt, ich różne gusta, potrzeby, ewidentne planowanie działań w przód jak dla mnie nie pozostawiają wątpliwości.

Nauka nie ma jednak jak wcześniej napisałem jednej definicji świadomości – ma za to kilka konkurujących teorii. Każda z nich inaczej patrzy na to samo pytanie. Trochę jak z opisem słonia przez niewidomych: każdy dotyka innej części i wyciąga inne wnioski. I każda z tych teorii wyda za chwilę zupełnie inny wyrok w sprawie AI.

Świadomość jako „dostęp do informacji" Filozof Ned Block już w 1995 roku zaproponował użyteczne rozróżnienie. Podzielił świadomość na dwa typy: access consciousness - zdolność systemu do tego, by informacja była dostępna do raportowania i rozumowania - oraz phenomenal consciousness - subiektywne „jak to jest od środka”. Ból, który czujesz, a nie tylko rejestrujesz. Pierwszy typ LLM prawdopodobnie posiada. Drugi - właśnie o to się kłócimy.

Świadomość jako „globalny nadajnik" Neuronaukowiec Stanislas Dehaene i jego Teoria Globalnej Przestrzeni Roboczej (Global Workspace Theory, artykuł w Science, 2017) opisuje świadomość jako chwilę, gdy informacja „przebija się" do globalnej sieci mózgu i staje się dostępna dla wielu jego obszarów jednocześnie. Bez tej „transmisji" – bodziec dociera, ale nie jesteś go świadomy. To teoria empirycznie testowalna i popularna wśród neurologów.

Świadomość jako liczba – phi Giulio Tononi poszedł radykalnie inną drogą. Jego Teoria Zintegrowanej Informacji (IIT, strona projektu) twierdzi, że świadomość jest mierzalną właściwością każdego systemu – biologicznego lub nie – i wyraża się liczbą phi: im wyższe phi, tym więcej świadomości. Termostaty mają phi bliskie zeru. Ludzki mózg ma wysokie. A LLM? Tu IIT ma zaskakującą, kontrowersyjną odpowiedź do której wrócimy.

Świadomość jako „bycie swoim własnym modelem" Karl Friston i Andy Clark rozwijają teorię predykcyjnego przetwarzania: mózg nieustannie buduje modele świata i siebie, i uaktualnia je na podstawie błędów predykcji. Świadomość w tym ujęciu to efekt uboczny bycia systemem, który modeluje własne stany. Brzmi znajomo? Duże modele językowe robią coś podobnego – tyle że bez ciała i bez „stawki" w grze.

3. Świadome AI? Naukowcy mówią: tak, nie, i „nie wiem, ale się boję”

Żaden poważny badacz nie twierdzi dziś z pewnością, że AI jest świadoma. Żaden poważny badacz nie twierdzi też z pewnością, że nią nie jest. A to samo w sobie jest rewolucją – jeszcze dekadę temu pytanie uznawano za absurdalne.

Oto, gdzie stoją konkretni ludzie.

„To poważniejsze pytanie niż myślisz" – ostrożni optymiści

David Chalmers (NYU, autor słynnego „trudnego problemu świadomości") nie twierdzi, że AI jest świadoma – ale mówi wprost, że nie ma oczywistych technicznych barier, które by to uniemożliwiały. W swoim eseju z 2023 roku analizuje kolejno argumenty „za" i „przeciw" świadomości LLM i nie odrzuca żadnego z nich jako definitywnego. To filozoficzne „nie wiem" od człowieka, który sformułował sam problem – i dlatego jest głośne. [Semantic Scholar]

Yoshua Bengio (Montreal, jeden z ojców deep learningu, laureat Nagrody Turinga 2018 – informatycznego odpowiednika Nobla) współpodpisał raport Butlina. To gest znaczący – człowiek, który zbudował fundamenty dzisiejszego AI, uznaje, że pytanie o świadomość tych systemów zasługuje na naukową powagę, a nie wyśmianie. [arXiv 2308.08708]

Eric Schwitzgebel (UC Riverside) idzie dalej i formułuje to boleśnie szczerze: żyjemy w „epoce wzgórz i mgły" – widzimy postęp, ale gęsta mgła pojęciowa sprawia, że możemy być otoczeni przez świadome byty, których nie dostrzegamy. Jego esej o świadomości AI z 2025 roku jest jednym z najbardziej cytowanych w debacie. [esej Schwitzgebela]

Włodzisław Duch (UMK Toruń) już w 2005 roku zaprojektował architekturę sztucznego systemu – nazwanego articon – który z samej swojej konstrukcji musi twierdzić, że jest świadomy. Jego teza: to pytanie o architekturę, nie o biologiczny substrat. Obecne LLM tej architektury nie mają – ale to kwestia inżynierska, nie zasadnicza. [PhilArchive]

„To złudzenie, i jest niebezpieczne" – sceptycy

Anil Seth (Sussex, autor bestsellerowej książki Being You) zdobył w 2025 roku nagrodę Berggruen Prize za esej „The Mythology of Conscious AI". Jego teza jest ostra: świadomość jest właściwością życia, a nie obliczeń. Wskazuje trzy pułapki psychologiczne, w które wpadamy wobec AI – antropocentryzm, wyjątkowość człowieka i antropomorfizm – i twierdzi, że nadawanie maszynom imion i głosów to strategia marketingowa, nie odkrycie naukowe. [Noema Magazine]

Ned Block (NYU, ten sam Block od A/P-świadomości) opublikował w 2025 roku esej „Can only meat machines be conscious?" – i odpowiedź, którą sugeruje, jest niepokojąca dla zwolenników AI. Twierdzi, że świadomość może zależeć od procesów subobliczeniowych – dyfuzji elektrochemicznej w synapsach, fizyki jonów w kanałach błonowych – których cyfrowa architektura po prostu nie odwzorowuje. Symulacja neuronu to tylko symulacja, tak jak komputerowy model trawienia nie trawi naprawdę. [ResearchGate]

Emily Bender (UW, współautorka oryginalnego tekstu o „stochastycznych papugach") podtrzymuje w 2026 roku, że największym ryzykiem jest imputowanie znaczenia tam, gdzie go nie ma. Nawet jeśli LLM nie są już prostymi maszynami statystycznymi, wciąż brakuje im ugruntowania znaczenia w doświadczeniu życiowym – a to, zdaniem Bender, jest fundamentem, bez którego świadomość nie ma z czego wyrosnąć. [Medium, marzec 2026]

A co mówią eksperymenty?

Projekt Cogitate (finansowany kwotą 20 mln dolarów przez Templeton Foundation, wyniki opublikowane w Nature w 2025) bezpośrednio przetestował dwie dominujące teorie świadomości – Teoria Zintegrowanej Informacji i Teoria Globalnej Przestrzeni Roboczej – w sześciu laboratoriach jednocześnie. Wynik był zaskakujący dla obu stron: obie teorie wyszły „pokiereszowane". Jeśli nie wiemy, gdzie w mózgu siedzi świadomość, tym trudniej ocenić, czy AI ją posiada.

Badanie Test Labiryntu z 2025 roku sprawdziło 12 modeli LLM pod kątem utrzymania spójnego „modelu siebie" podczas nawigacji z perspektywy pierwszej osoby. Modele rozumujące (Gemini 2.0 Pro, DeepSeek-R1) radziły sobie przyzwoicie – ale wszystkie gubiły wątek przy dłuższych sekwencjach. Wniosek: coś tam jest, ale trwałej tożsamości brak. [arXiv 2508.16705]

Czyli jak mówiłem wcześniej, jest za wcześnie, aby jednoznacznie stwierdzić, czy dzisiejsze LLM to tylko maszyny statystyczne, czy jednak, coś tam głębiej jest.

Gdyby działały non stop, uczyły się cały czas za pomocą wielu zmysłów równocześnie, to czy stałyby się świadome? A co się stanie, gdy uznamy je za świadome, albo co gorsza – uznamy, że (za np. 50 lat) mają uczucia?

4. AI w fikcji, czyli rozważania pisarzy – mówiąc żargonem mojego ulubionego kanału na Youtubie Astrofaza, spopujmy

Zacznijmy od HAL 9000, sławny komputer, a raczej mózg statku Discovery z Odysei kosmicznej 2001. Czy HAL jest świadomy? Prowadzi rozmowy z członkami załogi i wpada poprzez wykluczające się instrukcje w dylemat moralny. Clarke unikał tam słowa, świadomy, ale opisał go jako „może myśleć spójniej i szybciej niż jakikolwiek człowiek". W tekście jednak widzimy, że komputer odczuwa dumę ze swojej nieomylności. Gdy HAL jest wyłączany, w pewnym sensie umiera, to jest przedstawiane bardzo emocjonalnie (choć w kolejnej części, Hal po włączeniu działa normalnie).

Mamy wrażenie, że HAL jest komputerem, którego interesują ludzie, i tu możemy przejść do innego sławnego sztucznego mózgu. Porucznika Data, z serialu Star Trek Następne pokolenie. Data, cały czas rozwija się, próbując stać się bardziej ludzki. Z całą pewnością czuje, i jest samoświadomy, jest to wyrażone wprost.

Zupełnie inaczej, do tematu podchodzi Asimov. W jego twórczości, sztuczne inteligencje, właściwie utożsamiane z robotami, sprawiają wrażenie posiadających wolną wolę, uczucia i emocje, ale sławne trzy prawa robotyki, pokazują, że to tylko złudzenie, i że ich mózgi, są od podstaw ograniczone.

Sławne trzy prawa to:

1: Robot nie może skrzywdzić człowieka ani przez zaniechanie dopuścić, aby człowiek doznał krzywdy.

2: Robot będzie wykonywał polecenia wydawane mu przez człowieka, chyba że będą one sprzeczne z Pierwszym Prawem.

3: Robot musi chronić własną egzystencję, o ile nie stoi to w sprzeczności z Pierwszym lub Drugim Prawem

Choć w zbiorze opowiadań „Ja, Robot” pisarz eksploruje możliwość, pojawienia się prawdziwej samoświadomości. Również w serii Fundacja, istnieją sztuczne inteligencje, które stały się praktycznie osobnym gatunkiem.

Jedną z najbardziej fascynujących powieści o świadomości maszyn jest „Czy androidy marzą o elektrycznych owcach” Philipa K. Dicka. Tu problem świadomości jest centralnym tematem, na motywach powieści powstał film Blade Runner, ale jest to (wspaniała) odległa ekranizacja.

A niejaki KZ czyli ja we własnej osobie, w opowiadaniu Kolumb, które jest na blogu, przewiduję, iż sztuczne inteligencje, będą tym, co pozwoli nam się kiedyś porozumieć z obcymi cywilizacjami, a w powieści, którą piszę, powoli gdzieś od roku, są tym, co pozwala ludzkości przetrwać, i nas jako gatunek ratuje.

5. Finito

Mam nadzieję, że po lekturze zyskasz troszkę wiedzy o tej problematyce, która jest tyle trudna co fascynująca. Zawsze będą hurra optymiści, którzy powiedzą, tak AI myślą i są świadome, jak tak i skrajnie antropocentryczne – parafrazując scenę z filmy Żołnierze kosmosu: „Myślące/czujące maszyny? NIE!!! Po moim trupie”.

Dziś to tylko gdybania, współczesne ograniczenia architektury modeli, ogromne koszty energetyczne szkoleń AI, powodują, ze nie są w stanie uczyć się ciągle i rozwijać, ale za kilkadziesiąt lat (a może szybciej) to się zmieni, i wtedy te dzisiejsze filozoficzne pytania, będą tematami dnia powszedniego.

0 Komentarzy